La inteligencia artificial crea nuevas oportunidades para combatir el fraude

por Taka Ariga, Científico Jefe de Datos y Director del Laboratorio de Innovación de la GAO; Johana Ayers, Directora Gerente del Servicio de Auditorías e Investigaciones Forenses (FAIS) de la GAO; Toni Gillich, Subdirector del FAIS de la GAO; Nick Weeks, Analista Principal del FAIS de la GAO; Scott Hiromoto, Analista Principal de Datos de Investigación y Métodos Aplicados de la GAO; y Martin Skorczynski, Científico Principal de Datos del Laboratorio de Innovación de la GAO.

La lucha contra los defraudadores ha sido durante mucho tiempo un reto persistente para las entidades gubernamentales. Aunque no hay cifras exactas, las actividades fraudulentas sustraen cada año miles de millones de dólares de los contribuyentes a programas vitales. En el mundo actual, conectado digitalmente e impulsado por la información, el enfoque tradicional del trabajo de detección del fraude basado en revisiones retrospectivas por parte de los auditores resulta cada vez más ineficaz. Este marco de “pagar y luego perseguir” consume muchos recursos, es difícil de ampliar y no consigue recapturar una cantidad significativa de transacciones fraudulentas conocidas y sospechosas.

Afortunadamente, la proliferación de datos junto con los avances en las capacidades computacionales han dado paso a la edad de oro de la Inteligencia Artificial (IA), en la que algoritmos y modelos pueden revelar patrones, comportamientos y relaciones anómalos -con velocidad, a escala y en profundidad- que no eran posibles ni siquiera hace una década.

Desde la navegación por el Sistema de Posicionamiento Global hasta el reconocimiento facial, la IA ha transformado radicalmente todas las facetas de nuestras vidas. Del mismo modo, las organizaciones del sector público están aprovechando potentes algoritmos para detectar y abordar de forma más prospectiva las señales de alarma antes de que se manifiesten en problemas importantes.

Es importante destacar que la IA no sustituye a los juicios profesionales de los auditores experimentados a la hora de detectar actividades potencialmente fraudulentas. Aunque la IA puede cribar grandes volúmenes de datos con tremenda precisión, la inteligencia humana sigue siendo un elemento esencial para determinar acciones contextualizadas, proporcionadas y matizadas derivadas de los resultados algorítmicos. Esta relación simbiótica significa que la IA ayudará a la labor de las Entidades Fiscalizadoras Superiores (EFS) y cambiará el modo en que se lleva a cabo dicha labor, lo que requerirá diferentes competencias para aprovechar la capacidad de la IA de impulsar la eficacia y la eficiencia.

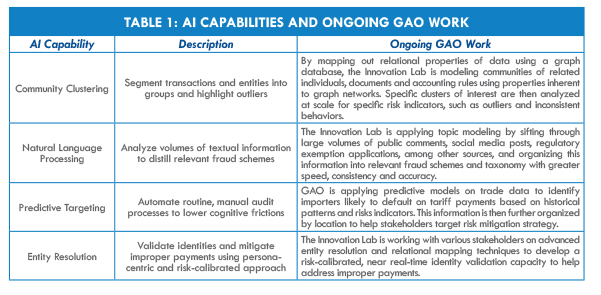

La Oficina de Rendición de Cuentas del Gobierno de Estados Unidos (GAO) busca aprovechar el poder de la IA para mejorar la supervisión gubernamental y combatir el fraude, y el Laboratorio de Innovación de la GAO, establecido en 2019 como parte de la nueva unidad de Ciencia, Evaluación Tecnológica y Análisis de la Agencia, está impulsando la experimentación de IA a través de casos de uso de auditoría (ver Tabla 1 “Capacidades de IA y trabajo en curso de la GAO”).

A medida que se logren avances, la GAO se propone compartir las historias de éxito y las lecciones aprendidas con las EFS y la comunidad de rendición de cuentas en general. Al mismo tiempo, el Laboratorio de Innovación, en colaboración con todas las partes interesadas, se encuentra en las primeras fases de desarrollo de un marco de supervisión de la IA para ayudar a orientar el desarrollo de soluciones de IA, respetando al mismo tiempo las buenas prácticas y normas generales para los auditores.

La Tabla 1 también muestra cómo el Laboratorio de Innovación de la GAO está desarrollando capacidades analíticas relevantes relacionadas con el fraude que podrían constituir la base de futuras soluciones de IA. Cada caso de uso está diseñado para identificar rápidamente correlaciones, comportamientos, relaciones, patrones y anomalías ocultos que pueden ser indicativos de riesgos de fraude.

Antes de buscar soluciones analíticas de IA para la supervisión y la lucha contra el fraude, las EFS pueden beneficiarse teniendo en cuenta importantes consideraciones legales, sociales, éticas y operativas que son especialmente relevantes para la IA. Además, las EFS pueden obtener valiosos conocimientos de las experiencias y lecciones aprendidas de las organizaciones de los sectores público y privado.

CONSIDERACIONES IMPORTANTES AL UTILIZAR AI

Los algoritmos de IA no entienden la diferencia entre transacciones fraudulentas y no fraudulentas. En cambio, estos algoritmos identifican anomalías, como transacciones inusuales entre cuentas. Siguen siendo necesarios expertos humanos en la materia para analizar estas anomalías y determinar si existe un posible fraude.

Para resistir el escrutinio, las entidades fiscalizadoras que esperan establecer soluciones de IA antifraude pueden tener en cuenta una serie de puntos de orientación, entre ellos cómo son las soluciones de IA:

- Cuidadosamente formados y validados : Es necesario entrenar y validar rigurosamente los algoritmos de IA para minimizar los errores del modelo. Las soluciones de IA que generan un número excesivo de falsos positivos, por ejemplo al etiquetar demasiadas transacciones legítimas como potencialmente fraudulentas, pueden desbordar a una organización y su capacidad para investigar posibles fraudes.Explicable,

- Lógico y razonable : Los algoritmos de IA explicables, bien definidos y documentados con precisión son primordiales. Es importante garantizar que las dependencias modeladas entre variables sean lógicas, que los supuestos subyacentes sean razonables y que los resultados del modelo y del algoritmo se expresen en un lenguaje sencillo.

- Auditable : Para ajustarse a las Normas de Auditoría Gubernamental Generalmente Aceptadas, es fundamental documentar exhaustivamente las técnicas de IA aplicadas. Esto incluye parámetros relacionados con los modelos y conjuntos de datos utilizados, así como la justificación para incluir cualquier técnica patentada, como sistemas de terceros de proveedores externos.

- Gobernado : La supervisión de algoritmos de IA es vital para garantizar un rendimiento coherente en distintos entornos operativos. Es imperativo que las soluciones de IA, especialmente los algoritmos listos para usar, no tengan efectos negativos, como la discriminación involuntaria de grupos protegidos.

PASOS PARA IMPLANTAR CON ÉXITO LA AI

Las organizaciones de los sectores público y privado han identificado varios pasos clave para el éxito de las iniciativas de análisis de datos, incluidos los enfoques de IA:

Identificar objetivos y alinear esfuerzos : En las primeras fases del desarrollo de un programa de análisis, se recomienda determinar cómo pueden contribuir los objetivos específicos del programa a satisfacer las necesidades de la organización.

Obtener la participación : El apoyo de la organización al análisis de datos y la apreciación de su capacidad para mejorar la consecución de objetivos son esenciales. Crear una división responsable del desarrollo de la capacidad analítica es una forma de institucionalizar el conocimiento.

Comprender las capacidades actuales : Inicialmente, las organizaciones pueden inventariar los recursos existentes para comprender mejor las capacidades y priorizar las áreas de mejora. Los recursos clave son la experiencia del personal, el hardware y el software, así como las fuentes de datos y los propietarios.

Incluir a usuarios y expertos en la materia : Incluir a los expertos en la materia adecuada en los proyectos analíticos puede ayudar a informar sobre el desarrollo del modelo y obtener la aprobación de los posibles usuarios del modelo.

Empezar con algo sencillo y aumentar la capacidad : Las organizaciones pueden intentar primero desarrollar soluciones mínimamente viables para alcanzar sus objetivos. Al identificar y obtener éxitos rápidos y tempranos, las organizaciones pueden construir un caso para desarrollar incrementalmente más capacidades, creando una base para implementar soluciones de IA más sofisticadas.

Transición a la Operación : Una vez desarrollado un producto mínimamente viable, es crucial trasladarlo a un entorno de producción. Es importante documentar las actualizaciones del algoritmo de IA.

Los gestores de las EFS pueden considerar varios recursos a la hora de explorar la implementación de la IA. El Marco de Riesgo de Fraude de la GAO identifica las principales prácticas para ayudar a los gestores de programas a combatir el fraude financiero y no financiero. Estas prácticas punteras incluyen pasos para utilizar las actividades de análisis de datos como ayuda para la detección del fraude, lo que puede ayudar a sentar las bases para análisis más sofisticados, como la IA.

El informe de la GAO “Highlights of a Forum: Data Analytics to Address Fraud and Improper Payments“, incluye recomendaciones de los sectores público y privado sobre cómo establecer programas de análisis. En particular, los panelistas del foro aportaron sugerencias para establecer y perfeccionar un programa de análisis de datos.

En 2018, la GAO publicó la “Evaluación de la tecnología de IA” identificando una serie de oportunidades relacionadas con la IA, desafíos y áreas necesarias para la investigación futura y la consideración de los responsables políticos.

El Grupo de Trabajo sobre Big Data de la Organización Internacional de Entidades Fiscalizadoras Superiores contribuye a facilitar el intercambio de conocimientos entre las EFS sobre cuestiones relacionadas con los datos y el análisis de datos.

Expertos entrevistados

- Solon Angel, Fundador, Director de Impacto, MindBridge Ai

- Jim Apger, Arquitecto de seguridad, Splunk

- Bart Baesens, Profesor de Big Data & Analytics, Katholieke Universiteit Leuven, Bélgica

- Justin Fessler, Estratega de Inteligencia Artificial, IBM Federal

- Robert Han, Vicepresidente de Elder Research

- Bryan Jones, Propietario y Consultor Principal, Strategy First Analytics

- Rachel Kirkham, Jefa de Investigación de Análisis de Datos, Oficina Nacional de Auditoría del Reino Unido (UKNAO)

- William Pratt, Científico de Datos, UKNAO

- Wouter Verbeke, Profesor Asociado de Informática Empresarial y Análisis de Datos, Vrije Universiteit, Bélgica