بقلم تاكا أريجا ، كبير علماء البيانات بمكتب المساءلة الحكومية الأمريكية (GAO) ومدير مختبر GAO للابتكار ؛ جوهانا آيرز ، العضو المنتدب ، GAO Forensic Audit and Investigative Service (FAIS) ؛ توني جيليش ، مساعد مدير GAO FAIS ؛ نيك ويكس ، كبير محللي GAO FAIS ؛ سكوت هيروموتو ، كبير محللي البيانات في مكتب المساءلة الحكومية للبحوث التطبيقية والأساليب ؛ و Martin Skorczynski ، كبير علماء البيانات ، GAO Innovation Lab

لطالما كانت مكافحة المحتالين تحديًا مستمرًا للهيئات الحكومية. في حين لا توجد أرقام دقيقة ، فإن الأنشطة الاحتيالية تستنزف مليارات الدولارات من دافعي الضرائب كل عام من البرامج الحيوية. في عالم اليوم المتصل رقميًا والمدفوع بالمعلومات ، أصبح النهج التقليدي لعمل الكشف عن الاحتيال المستند إلى المراجعات بأثر رجعي من قبل المدققين غير فعال بشكل متزايد. إن إطار عمل “الدفع ثم المطاردة” هذا كثيف الموارد ويصعب قياسه ويفشل في استعادة قدر كبير من المعاملات الاحتيالية المعروفة والمشتبه بها.

لحسن الحظ ، أدى انتشار البيانات جنبًا إلى جنب مع التقدم في القدرات الحسابية إلى دخول العصر الذهبي للذكاء الاصطناعي (AI) ، حيث يمكن للخوارزميات والنماذج الكشف عن أنماط وسلوكيات وعلاقات شاذة – بسرعة وعلى نطاق وعمق – لم يكن ذلك ممكنًا حتى قبل عقد من الزمان.

من التنقل في نظام تحديد المواقع العالمي إلى التعرف على الوجه ، غيّر الذكاء الاصطناعي بشكل أساسي كل جانب من جوانب حياتنا. وبالمثل ، تستفيد مؤسسات القطاع العام من الخوارزميات القوية للكشف المستقبلي عن العلامات الحمراء ومعالجتها قبل ظهورها في مشكلات مهمة.

الأهم من ذلك ، أن الذكاء الاصطناعي لا يحل محل الأحكام المهنية للمدققين ذوي الخبرة في الكشف عن الأنشطة الاحتيالية المحتملة. بينما يمكن للذكاء الاصطناعي فحص كميات كبيرة من البيانات بدقة هائلة ، فإن الذكاء البشري لا يزال عنصرًا أساسيًا لتحديد الإجراءات الخاصة بالسياق والمتناسبة والدقة التي تنبع من مخرجات الخوارزمية. تعني هذه العلاقة التكافلية أن الذكاء الاصطناعي سيساعد مؤسسة التدقيق العليا (SAI) في العمل وسيغير كيفية تنفيذ هذا العمل – يتطلب مهارات مختلفة لتسخير قدرة الذكاء الاصطناعي على زيادة الفعالية والكفاءة.

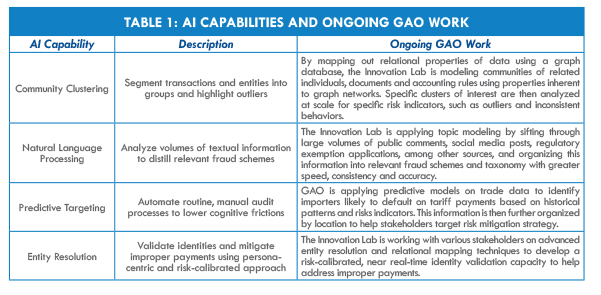

يسعى مكتب مساءلة الحكومة الأمريكية (GAO) إلى الاستفادة من قوة الذكاء الاصطناعي لتحسين الرقابة الحكومية ومكافحة الاحتيال ، ويقود مختبر الابتكار التابع لمكتب المساءلة الحكومية ، والذي تم إنشاؤه في عام 2019 كجزء من وحدة العلوم وتقييم التكنولوجيا والتحليلات الجديدة التابعة للوكالة ، تجارب الذكاء الاصطناعي عبر حالات استخدام التدقيق (انظر الجدول 1 “قدرات الذكاء الاصطناعي وعمل GAO المستمر”).

مع إحراز تقدم ، يهدف مكتب المساءلة الحكومية إلى مشاركة قصص النجاح والدروس المستفادة مع الأجهزة العليا للرقابة المالية والمحاسبة والمجتمع الأوسع للمساءلة. وفي الوقت نفسه ، فإن مختبر الابتكار ، بالاشتراك مع جميع أصحاب المصلحة المعنيين ، في المراحل الأولى من تطوير إطار رقابة للذكاء الاصطناعي للمساعدة في توجيه تطوير حلول الذكاء الاصطناعي مع الالتزام بالممارسات والمعايير الجيدة الشاملة للمدققين.

يوضح الجدول 1 أيضًا كيف يعمل مختبر الابتكار التابع لمكتب المحاسبة الحكومي على تطوير القدرات التحليلية المتعلقة بالاحتيال ذات الصلة والتي من المحتمل أن تشكل الأساس لحلول الذكاء الاصطناعي المستقبلية. تم تصميم كل حالة استخدام لتحديد الارتباطات والسلوكيات والعلاقات والأنماط والشذوذ الخفية التي قد تشير إلى مخاطر الاحتيال بسرعة.

قبل متابعة الحلول التحليلية للذكاء الاصطناعي للرقابة ومكافحة الاحتيال ، يمكن للأجهزة العليا للرقابة أن تستفيد من خلال النظر في الاعتبارات القانونية والمجتمعية والأخلاقية والتشغيلية الهامة ذات الصلة بالذكاء الاصطناعي بشكل خاص. علاوة على ذلك ، يمكن للأجهزة العليا للرقابة أن تكتسب رؤى قيمة من تجارب مؤسسات القطاعين العام والخاص والدروس المستفادة.

اعتبارات مهمة عند استخدام الذكاء الاصطناعي

لا تفهم خوارزميات الذكاء الاصطناعي الفرق بين المعاملات الاحتيالية وغير الاحتيالية. بدلاً من ذلك ، تحدد هذه الخوارزميات الحالات الشاذة ، مثل المعاملات غير العادية بين الحسابات. لا تزال هناك حاجة لخبراء في الموضوع البشري لتحليل هذه الحالات الشاذة لتحديد ما إذا كان الاحتيال المحتمل موجودًا.

لتحمل التدقيق ، قد تنظر مؤسسات التدقيق التي تأمل في إنشاء حلول ذكاء اصطناعي لمكافحة الاحتيال في مجموعة من النقاط التوجيهية ، بما في ذلك كيفية عمل حلول الذكاء الاصطناعي:

- تم تدريبه والتحقق منه بعناية : يلزم التدريب الصارم والتحقق من صحة خوارزميات الذكاء الاصطناعي لتقليل أخطاء النموذج. حلول الذكاء الاصطناعي التي تولد نتائج إيجابية زائفة مفرطة ، مثل تصنيف العديد من المعاملات المشروعة على أنها احتيالية ، يمكن أن تطغى على المؤسسة وقدرتها على التحقيق في الاحتيال المحتمل.يمكن شرحه

- منطقية ومعقولة : خوارزميات الذكاء الاصطناعي القابلة للتفسير والمحددة جيدًا والموثقة بدقة لها أهمية قصوى. من المهم التأكد من أن التبعيات المنمذجة بين المتغيرات منطقية ، والافتراضات الأساسية معقولة ، ويتم التعبير عن مخرجات النموذج والخوارزمية بلغة واضحة.

- قابل للتدقيق : للامتثال لمعايير التدقيق الحكومية المقبولة عمومًا ، يعد التوثيق الشامل لتقنيات الذكاء الاصطناعي المطبقة أمرًا بالغ الأهمية. يتضمن ذلك المعلمات المتعلقة بالنماذج ومجموعات البيانات المستخدمة بالإضافة إلى الأساس المنطقي لتضمين أي تقنيات مسجلة الملكية ، مثل أنظمة الطرف الثالث من البائعين الخارجيين.

- مُدار : يُعد الإشراف على خوارزمية الذكاء الاصطناعي أمرًا حيويًا لضمان الأداء المتسق عبر بيئات التشغيل المختلفة. من الضروري أن تكون حلول الذكاء الاصطناعي ، وخاصة الخوارزميات الجاهزة ، خالية من التأثيرات السلبية ، مثل التمييز غير المتعمد للمجموعات المحمية مرة أخرى.

خطوات للتنفيذ الناجح للذكاء الاصطناعي

حددت مؤسسات القطاعين العام والخاص عدة خطوات رئيسية لمبادرات تحليل البيانات الناجحة ، بما في ذلك مناهج الذكاء الاصطناعي:

تحديد الأهداف ومواءمة الجهود : يوصى بتحديد كيف يمكن لأهداف برنامج معينة أن تساعد في تلبية الاحتياجات التنظيمية في المراحل الأولى من تطوير برنامج التحليلات.

الحصول على الشراء : يعد الدعم التنظيمي لتحليلات البيانات وتقدير قدرتها على تعزيز تحقيق الهدف أمرًا ضروريًا. يعد إنشاء قسم مسؤول عن تطوير القدرة التحليلية إحدى الطرق لإضفاء الطابع المؤسسي على المعرفة.

فهم القدرات الحالية : في البداية ، يمكن للمؤسسات جرد الموارد الحالية لفهم القدرات بشكل أفضل وتحديد أولويات مجالات التحسين. تشمل الموارد الرئيسية خبرة الموظفين والأجهزة والبرامج بالإضافة إلى مصادر البيانات ومالكيها.

تضمين المستخدمين وخبراء الموضوع : يمكن أن يساعد تضمين خبراء الموضوع المناسبين في مشاريع التحليلات في إعلام تطوير النموذج والحصول على دعم من مستخدمي النموذج النهائيين.

ابدأ ببناء القدرات بشكل بسيط وتدريجي : قد تسعى المنظمات أولاً إلى تطوير حلول قابلة للتطبيق إلى الحد الأدنى لتحقيق الأهداف. من خلال تحديد النجاحات السريعة والمبكرة والحصول عليها ، يمكن للمؤسسات بناء حالة لتطوير المزيد من القدرات بشكل تدريجي ، وإنشاء أساس لتنفيذ حلول ذكاء اصطناعي أكثر تطوراً.

الانتقال إلى التشغيل : بمجرد تطوير منتج قابل للتطبيق إلى الحد الأدنى ، يكون نقله إلى بيئة إنتاج أمرًا بالغ الأهمية. من المهم توثيق تحديثات خوارزمية الذكاء الاصطناعي.

يمكن لمديري الأجهزة العليا للرقابة المالية والمحاسبة النظر في العديد من الموارد أثناء استكشاف تطبيق الذكاء الاصطناعي. يحدد إطار عمل مخاطر الاحتيال في مكتب المساءلة الحكومية الممارسات الرائدة لمساعدة مديري البرامج على مكافحة الاحتيال المالي وغير المالي. تتضمن هذه الممارسات الرائدة خطوات لاستخدام أنشطة تحليل البيانات للمساعدة في الكشف عن الاحتيال ، والتي يمكن أن تساعد في إنشاء أساس لتحليلات أكثر تعقيدًا ، مثل الذكاء الاصطناعي.

مكتب المساءلة العامة ” يسلط الضوء على المنتدى: تحليلات البيانات لمعالجة الاحتيال والمدفوعات غير اللائقة ” ، يتضمن توصيات من القطاعين العام والخاص حول كيفية إنشاء برامج التحليلات. على وجه الخصوص ، قدم أعضاء المنتدى اقتراحات حول إنشاء وتنقيح برنامج تحليلات البيانات.

في عام 2018 ، نشر مكتب المساءلة الحكومية (GAO) ” تقييم تكنولوجيا الذكاء الاصطناعي ” الذي يحدد مجموعة من الفرص والتحديات والمجالات المتعلقة بالذكاء الاصطناعي اللازمة للبحث المستقبلي ودراسة صناع السياسات.

تساعد مجموعة العمل التابعة للمنظمة الدولية للمؤسسات العليا للرقابة المالية والمعنية بالبيانات الضخمة على تسهيل تبادل المعرفة بين الأجهزة العليا للرقابة المالية والمحاسبة حول القضايا المرتبطة بتحليل البيانات والبيانات.

موضوع تمت مقابلة الخبراء

- سولون أنجل ، المؤسس ، كبير مسؤولي التأثير ، MindBridge Ai

- جيم أبجر ، مهندس أمن ، شركة Splunk

- بارت بايسنس ، أستاذ البيانات الضخمة والتحليلات ، جامعة كاثوليكي لوفين ، بلجيكا

- جاستن فيسلر ، استراتيجي الذكاء الاصطناعي ، IBM Federal

- روبرت هان ، نائب الرئيس ، أبحاث كبار السن

- بريان جونز ، المالك والمستشار الرئيسي لشركة Strategy First Analytics

- راشيل كيركهام ، رئيس أبحاث تحليلات البيانات ، مكتب التدقيق الوطني بالمملكة المتحدة (UKNAO)

- وليام برات ، عالم البيانات ، UKNAO

- فوتر فيربيكي ، أستاذ مشارك في معلوماتية الأعمال وتحليلات البيانات ، جامعة فريي ، بلجيكا